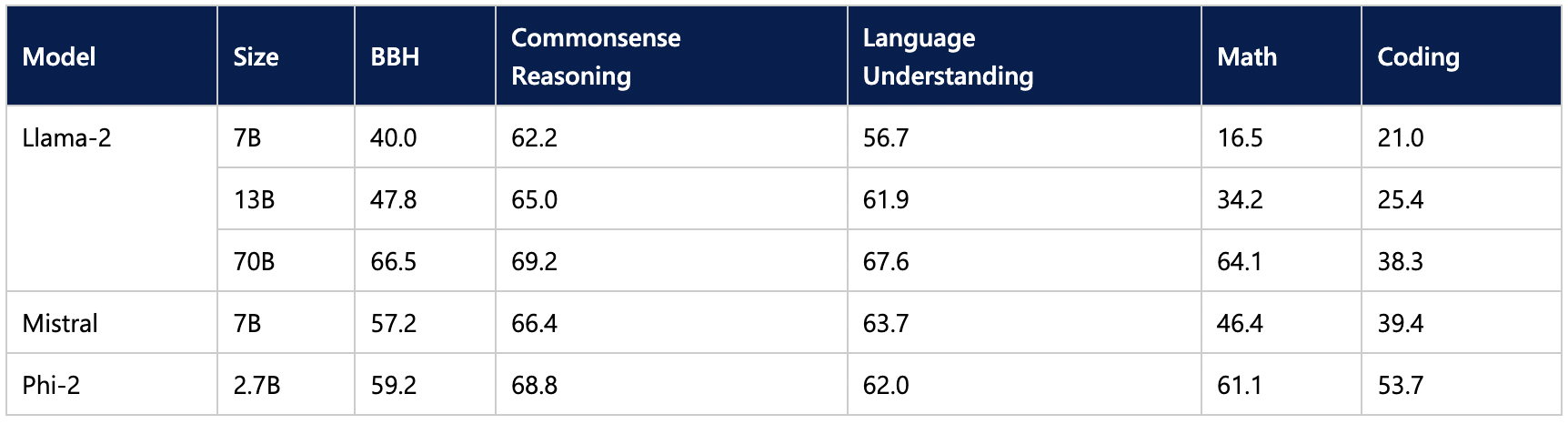

با داغ شدن مسابقه مدلهای بزرگ زبانی (LLM) شاهد معرفی مدلهای کوچک زبانی (SLM) نیز هستیم. در حال حاضر LLMها از چند ده میلیارد، تا چند میلیارد و حتی چند تریلیون پارامتر دارند. تعداد پارامترهای یک مدل تعداد متغیرهای مجهول آن را مشخص میکند که در پروسه Training مقدار دهی میشوند. هر چقدر تعداد پارامترهای یک مدل بیشتر باشد، پروسه آموزش آن زمانبر و هزینهبر شده و در نهایت خروجی آن نیز سایز زیادی خواهد داشت. اجرای مدلهای بزرگ زبانی نیازمند منابع پردازشی زیاد است. به طوری که اجرای آن در لپتاپهای معمولی و گوشیهای هوشمند با مشکل کمبود منابع رو به رو میشود. از اینرو، برای فراهم کردن قابلیتهای مدلهای زبانی برای پلتفرمهای مختلف شاهد توسعه و معرفی مدلهای کوچک زبانی یا SLMها هستیم. مدل Phi یکی از این SLMها بوده که توسط مایکروسافت منتشر شده است. در حال حاضر سه نسخه از این مدل با نامهای Phi1، Phi1.5 و Phi2 معرفی شدهاند. نسخه Phi2 که به تازگی منتشر شده در مقایسه با نمونههای مشابه نتایج درخور توجهی داشته است. مدل Phi2 دارای ۲.۷ میلیارد پارامتر است بنابراین حدوداً دو برابر سایز نسخه قبلی است (نسخه Phi1.5 دارای ۱.۳ میلیارد پارامتر است). کاهش سایز مدل زبانی و در عین حال افزایش کیفیت آن از ترندهای موجود در حوزه هوشمصنوعی مولد است. در جدول زیر عملکرد این مدل با مدلهای مشابه و حتی مدلهای بزرگتر نظیر Llama 70B ارائه شده است.

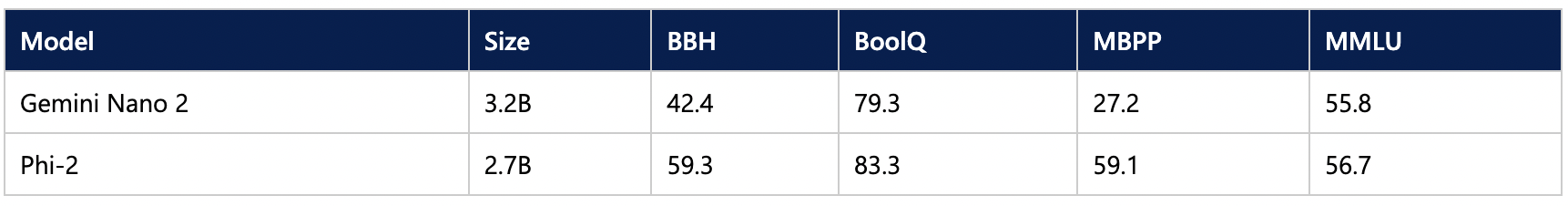

در جدول زیر نیز مقایسه Phi2 با Gemini Nano که به تازگی توسط گوگل معرفی شد ارائه شده است. نتایج Gemini Nano براساس گزارش منتشر شده توسط گوگل فراهم شده است.

مدل Phi2 بر پایه ترنسفومر بوده و با ۱.۴ تریلیون توکن آموزش داده شده است. آموزش این مدل با ۹۶ پردازنده NVIDIA A100 به مدت ۱۴ روز طول کشیده است. طبق گزارش مایکروسافت این مدل هنوز با روش یادگیری تقویتی از طریق فیدبک انسانی (RLHF) بهبود داده نشده است بنابراین انتظار میرود بعد از اعمال RLHF و fine tune کردن مدل برای کاربردهای خاص عملکرد آن بهبود پیدا کند. در تصویر زیر نمونهای از عملکرد Phi2 در حل مسئله فیزیک را مشاهده میکنید. مدل Phi از طریق Azure AI Studio در دسترس قرار گرفته است. برای دسترسی به Phi2 در پلتفرم HugginFace نیز اینجا را مشاهده کنید.

مدل Phi2 بر پایه ترنسفومر بوده و با ۱.۴ تریلیون توکن آموزش داده شده است. آموزش این مدل با ۹۶ پردازنده NVIDIA A100 به مدت ۱۴ روز طول کشیده است. طبق گزارش مایکروسافت این مدل هنوز با روش یادگیری تقویتی از طریق فیدبک انسانی (RLHF) بهبود داده نشده است بنابراین انتظار میرود بعد از اعمال RLHF و fine tune کردن مدل برای کاربردهای خاص عملکرد آن بهبود پیدا کند. در تصویر زیر نمونهای از عملکرد Phi2 در حل مسئله فیزیک را مشاهده میکنید. مدل Phi از طریق Azure AI Studio در دسترس قرار گرفته است. برای دسترسی به Phi2 در پلتفرم HugginFace نیز اینجا را مشاهده کنید.

۱. Phi-2: The surprising power of small language models

اگر مایل به دریافت این خبرنامه در پستالکترونیک خود هستید از اینجا ثبتنام کنید. این خبرنامه هر دو هفته به پست الکترونیک شما ارسال خواهد شد. همچنین میتوانید با عضو شدن در کانال تلگرام این خبرنامه، در سریعترین زمان در جریان مقالات جدید قرار بگیرید.

دیدگاه خود را بنویسید